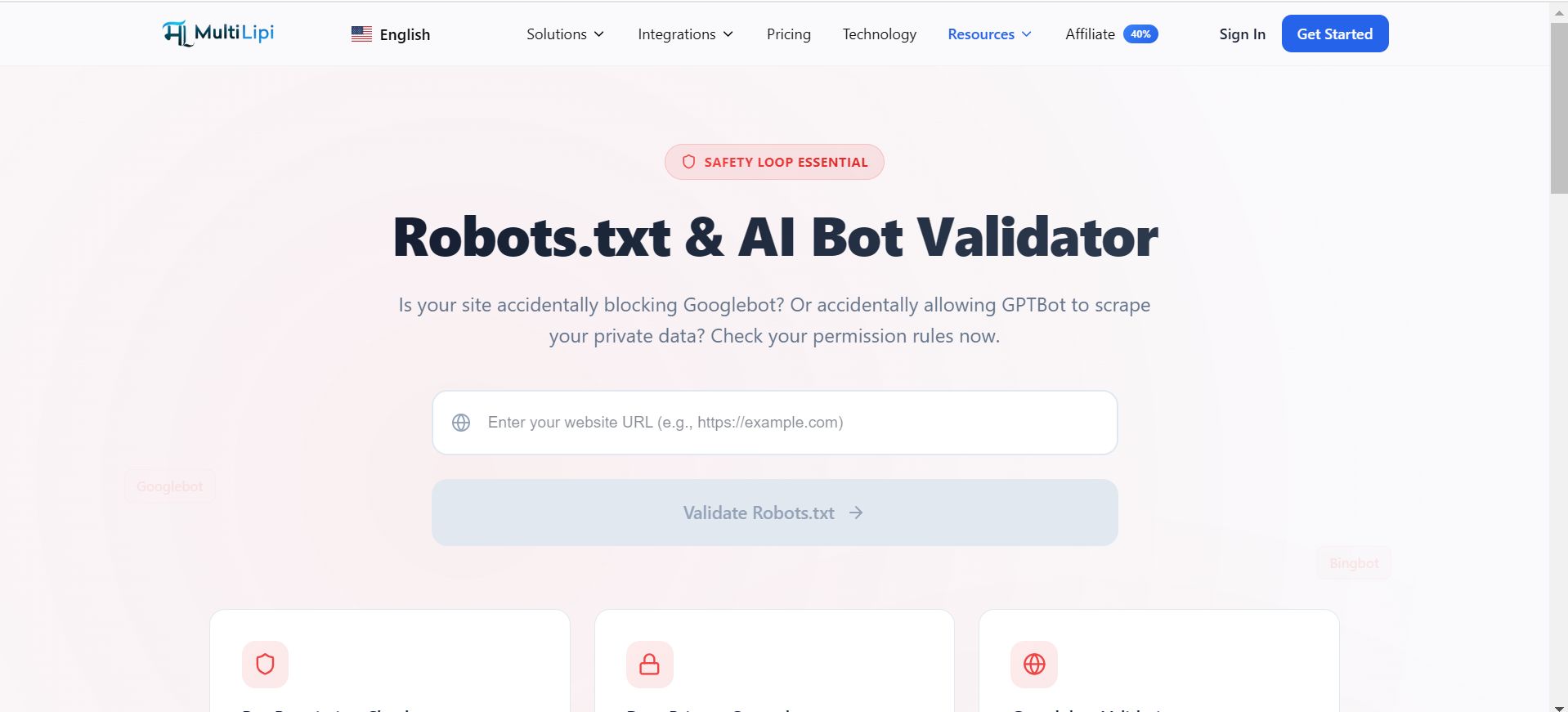

Verifica i permessi del tuo crawler e controlla lo scraping dei dati tramite IA—senza alcun costo.

Nell'epoca di IA generativa, il tuo file robots.txt è il documento di sicurezza più importante sul tuo server. È il guardiano che dice a Googlebot "Benvenuto" e a GPTBot (OpenAI) o CCBot (Common Crawl) se possono ingerire i tuoi contenuti proprietari per addestrare i loro modelli.

Il MultiLipi Robots.txt Validator è un'utilità ingegneristica gratuita progettata per verificare le tue regole di autorizzazione. Garantisce che tu non stia bloccando accidentalmente il traffico SEO mentre verifichi la tua posizione sugli agenti di scraping IA.

Il "Safety Loop" Essenziale

Visibilità SEO vs. Privacy AI.

Un singolo errore di sintassi in questo file può deindicizzare l'intero sito web da Google. Al contrario, una regola mancante può permettere alle aziende di IA di recuperare l'intero archivio del tuo blog senza alcun compenso.

Il rischio SEO

Bloccare Googlebot o Bingbot distrugge il traffico.

Il rischio dell'IA

Consentire GPTBot o ClaudeBot significa che il tuo contenuto diventa dati di addestramento.

L'Equilibrio

Il nostro strumento convalida che le tue direttive "Consenti" e "Disallow" siano sintatticamente corrette e mirano agli agenti specifici che intendi gestire.

Il Protocollo di Audit

Come convalidare il tuo gatekeeper.

Non dare per scontato che i tuoi permessi siano corretti. Verificali rispetto agli standard dei crawler vivi.

Accedi allo strumento gratuito

Naviga fino al Robots.txt Validator.

Endpoint di ingresso

Inserisci il tuo dominio radice (ad esempio, https://example.com).

Scansione Esecuzione

Clicca sul pulsante Valida Robots.txt.

Logica della Recensione

Esamina il controllo della sintassi, l'analisi specifica dei bot e la raggiungibilità.

Logica della recensione:

Controllo della sintassi: Segnalazioni di wildcard invalidi o errori di percorso

Analisi specifica dei bot: Controlla specificamente i permessi per i principali agenti come Googlebot, GPTBot, Bingbot e CCBot

Raggiungibilità: Conferma che il file è accessibile e restituisce un codice di stato 200 OK

Controllo del grafo della conoscenza

Decidi chi impara da te.

Se sei un editore premium o una piattaforma SaaS, potresti voler bloccare scraper AI generici mantenendo attivi i motori di ricerca.

Scenario

Vuoi apparire nei risultati di Google Search ma non vuoi che ChatGPT ripeta gratuitamente i tuoi articoli a pagamento.

Soluzione

Usa il validatore per assicurarti che il tuo User-agent: GPTBot Vieta: / la regola è implementata correttamente e distinta dal tuo User-agent: * Regole.

Sitemap multilingue

Collegare la tua infrastruttura.

La tua robots.txt è anche la stanza della mappa per i tuoi crawler. Dovrebbe collegarsi esplicitamente alla tua Sitemap XML.

L'assegno

Il nostro strumento verifica che un Mappa del sito: https://yoursite.com/sitemap.xml esiste una direttiva.

L'impatto globale

Questo è fondamentale per scoprire le tue sottodirectory localizzate (ad esempio, /Fr/, /ES/). Se il crawler non riesce a trovare la mappa tramite robots.txt, le tue pagine tradotte a livello profondo potrebbero rimanere scoperte.